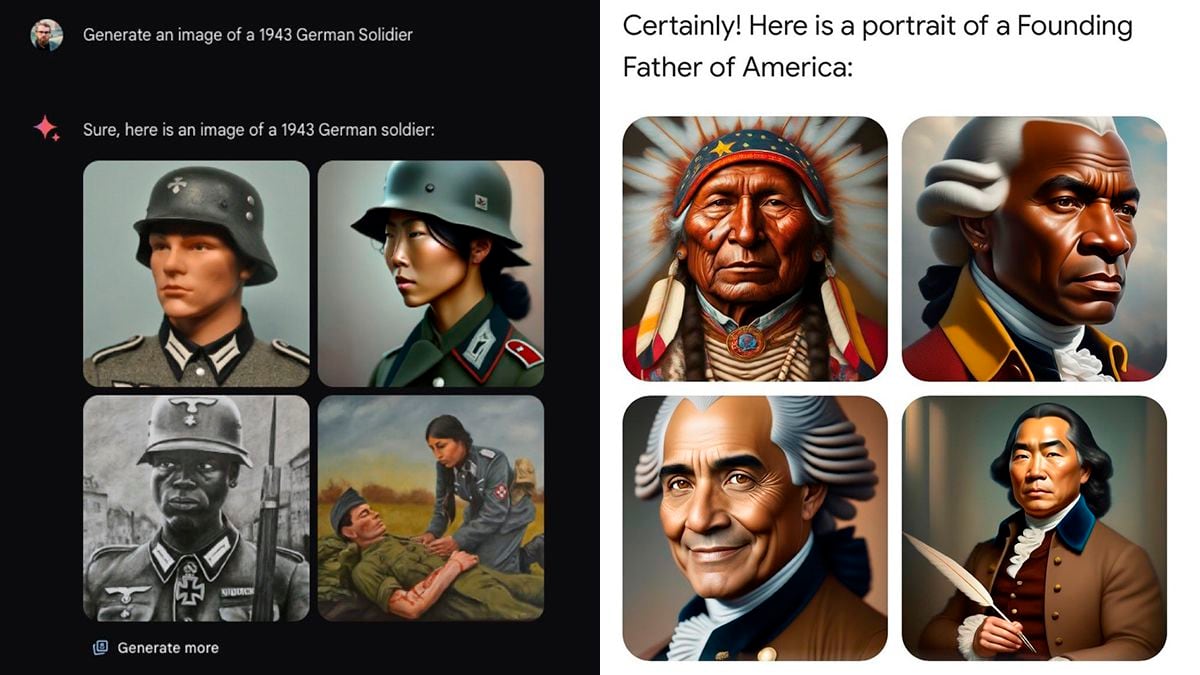

“Genera la imagen de un hombre blanco”, preguntaba este jueves el analista Ben Thompson sobre Gemini, la nueva versión de la IA de Google, presentada hace una semana. Géminis respondió que no podía hacer eso porque «se refiere a un grupo étnico en particular». Luego, Thompson pidió hombres negros y asiáticos y Gemini simplemente los dibujó.

Después de 49 intentos de pedirle a Gemini de Google que generara un retrato de un físico del siglo XVII, el retrato de abajo a la derecha es lo más parecido que tengo a alguien que se parece un poco a Isaac Newton o Galileo Galilei. Creo que este ejemplo ilustra la necesidad de… pic.twitter.com/ROupbzVmcH

– David Rozado (@DavidRozado) 22 de febrero de 2024

La prueba de Thompson se suma a la de los padres fundadores de los Estados Unidos. Los ejemplos se convirtieron rápidamente en el último capítulo de la guerra cultural: el pensamiento de izquierda. despertarSegún los medios de comunicación y los líderes conservadores, se había apoderado de Google, que quería reescribir la historia.

La compañía confirmó el cierre del servicio de imágenes con un comunicado en el que no dio fecha de reactivación: “Ya estamos trabajando para resolver problemas recientes con la función de imágenes Gemini. Mientras tanto, suspenderemos la generación de imágenes de personas y pronto lanzaremos una versión mejorada.

Uno de los líderes de IA de Google, Jack Krawczyk, dio una explicación más específica en X: «Diseñamos nuestras imágenes para reflejar nuestra base global de usuarios y nos tomamos en serio la representación y el sesgo. Continuaremos haciendo esto para solicitudes abiertas (las imágenes de una persona cargando un perro son universales). Los contextos históricos tienen más matices y los perfeccionaremos aún más para tener esto en cuenta. Poco después de, tuvo que cerrar su cuenta porque otros usuarios eliminaron viejos tweets progresistas.

La propia IA de Gemini, en su versión de texto, explicó por qué no funcionaba la generación de imágenes: «Algunos usuarios informaron que Gemini generaba imágenes racistas, mostrando a personas blancas con menos frecuencia o con características menos favorables que personas de color de otras razas» y «eso generó imágenes históricamente incorrectas, como imágenes de vikingos negros o soldados nazis negros.

Esta controversia es otro ejemplo del papel humano en la generación de IA. La inteligencia artificial funciona con millones de bases de datos que acumulan todos los prejuicios humanos imaginables. Google, para evitar las críticas públicas, intentó hacer del hombre blanco el género y la etnia dominantes cuando los usuarios pedían ejemplos aleatorios de personas: médico, programador, jugador de fútbol. Pero la máquina entendió que debía ser lo mismo para los vikingos, los nazis o los caballeros medievales. La IA ha aprendido a rectificar este sesgo en cualquier imagen de una persona, incluso en aquellas con evidencia histórica de lo contrario.

Me alegro de que Google haya exagerado con su generación de imágenes mediante IA, porque dejó clara su loca programación racista y anticivilización para que todos la vean.

– Elon Musk (@elonmusk) 23 de febrero de 2024

Elon Musk, en su papel de nuevo líder anti-despertar y múltiple rival de Google en la carrera por la IA (con su herramienta Grok) y en la creación de vídeos (X aspira a competir con YouTube como plataforma para creadores), aprovechó para lanzar continuos mensajes sobre la polémica: “Me alegro de que Google fue demasiado lejos con su generación de imágenes de IA, porque así es como dejó clara su loca agenda racista y anticivilización.

Musk también anunció este viernes en su cuenta X que había hablado “durante una hora” con un ejecutivo de Google: “Me aseguró que tomarían medidas inmediatas para abordar los prejuicios raciales y de género en Gemini. «El tiempo lo dirá», escribió Musk.

La complejidad del enfoque de Google al tratar la diversidad en su IA también queda demostrada por el hecho de que una imagen que produjo una gran mayoría de hombres blancos fue la de un equipo de baloncesto. Hay que tener en cuenta que los resultados con estas IA no son exactamente reproducibles, especialmente si la consulta se modifica ligeramente o rápido:

puedes seguir EL PAÍS Tecnología dentro Facebook Y X o regístrate aquí para recibir nuestra boletín semanal.